Image tirée du site de Saccage 2024

Depuis longtemps, les Jeux Olympiques et autres manifestations sportives mondialisées sont largement dénaturés par les logiques policières… Mais ces JO 2024 dits de Paris (qui concernent aussi l’ensemble du territoire métropolitain comme certains territoires d’outre-mer) dépassent la gestion policière de l’évènement pour imposer de nouvelles logiques sécuritaires qui dureront bien au delà des jeux.

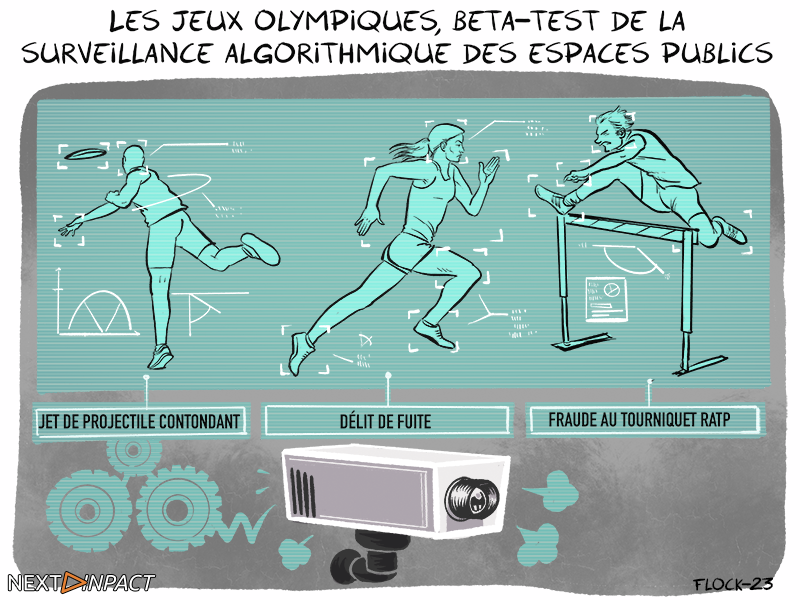

L’emploi des technologies de surveillance, de contrôle et de manipulation est une partie majeure de cette bascule. Ci-dessous extraits de divers articles qui permettent de s’en faire une idée.

« Restreindre les libertés publiques et aménager l’espace pour mettre les foules en flux«

Des villes verrouillées au nom de la sécurité, dans Le Monde Diplomatique de janvier 2024

Présentés comme l’« événement sécuritaire le plus important du monde en temps de paix » par Aldric Ludescher, chef de la sécurité du Comité international olympique (CIO), les Jeux organisés à Paris l’été prochain promettent un grand bond en avant dans la surveillance et la gestion des foules. Pareilles perspectives aiguisent l’appétit des industriels autant qu’elles alimentent l’angoisse des autorités.

Ces dernières s’emploient d’abord à empêcher les frictions sociales et urbaines : un dispositif d’expulsion de sans-abri et de migrants acheminera les indésirables dans des « sas » d’accueil situés dans d’autres régions de l’Hexagone, tandis que des arrêtés préfectoraux interdiront la distribution alimentaire dans le nord de la capitale. À la demande du ministre de l’intérieur, la préfecture de police a lancé à Paris et en Seine-Saint-Denis un plan dit « zéro délinquance« avec une présence renforcée des forces de l’ordre et une multiplication des contrôles.

Les perspectives de liberté et d’anonymat qui avaient alimenté l’attrait des villes dans l’imaginaire collectif seront anéanties pendant les Jeux, à en croire le préfet de police. Fin novembre dernier, M. Laurent Nuñez annonçait que des dispositions des lois antiterroristes régiraient un large périmètre de protection lors de la cérémonie d’ouverture.

Ce dispositif d’exception a déjà été utilisé 612 fois entre le 1er novembre 2017 et le 30 avril 2021 (d’après le rapport sénatorial Daubresse-Canayer), soit presque un jour sur deux. Diverses zones sont identifiées :

- Couvrant 5 % de la surface totale de la capitale, la première zone sera interdite aux véhicules des riverains, des hôpitaux ou cliniques, des dépanneurs (ascenseurs, canalisations) ou des transports de personnes handicapées. Les cyclistes y seront refoulés et les piétons soumis à un filtrage.

- Un deuxième périmètre de 20 kilomètres carrés (20 % de la surface parisienne) verra la circulation des véhicules motorisés entièrement « neutralisée » — y compris les services d’aide à domicile et les bus.

- Un dernier périmètre autorisera les véhicules à circuler sous réserve de pouvoir justifier de son déplacement (accès au domicile, travail, rendez-vous médical, etc.).

Ces dispositifs fonctionnent-ils ? La police loue leur efficacité dans les cas du 14-Juillet et du G7, mais la pagaille aux abords des stades défraie toujours la chronique. Comme celle survenue au Stade de France en mai 2022 en marge d’un match de football Liverpool-Real Madrid : l’affaire provoqua un incident diplomatique entre Londres et Paris.

Au demeurant, l’essentiel est ailleurs. Pour la chercheuse Myrtille Picaud, spécialiste des marchés urbains de la sécurité numérique, ces moments de fête, et de sponsoring, offrent aux industriels l’occasion d’« une grande démonstration du savoir-faire français à destination des marchés extérieurs ». Mais il s’agira aussi d’« expérimenter ce que l’on peut faire techniquement et juridiquement, ce que l’on pourra stabiliser dans le temps ou non« .

En plus de la vidéosurveillance algorithmique qui sera alors officiellement déployée — elle est en réalité utilisée en toute illégalité depuis des années (voir Les cuisines de la surveillance automatisée, Le Monde diplomatique de février 2023) —, un appel à projets accéléré lancé en 2019 par l’Agence nationale de la recherche (ANR) et le secrétariat général de la défense et de la sécurité nationale (SGDSN) vise à « développer les meilleures solutions technologiques pour répondre aux problématiques de sécurité que posent ces événements d’envergure ».

Ces financements publics doivent offrir « une opportunité pour la filière des industries de sécurité en termes de structuration, de développement de l’innovation et de rayonnement international« (d’après l’Agence nationale de la recherche). Un autre programme, lancé en avril 2022 par le comité stratégique de filière (CSF) en coopération avec le ministère de l’intérieur, illustre cette transformation de l’espace public en laboratoire d’« expérimentation de 200 solutions grâce à la mobilisation de 89 entreprises » (d’après le GICAT, Groupement des industries françaises de défense et de sécurité terrestres et aéroterrestres).

Alors que Paris se transforme peu à peu en aéroport, les champions de la sécurité urbaine, eux, ont déjà remporté l’or…

Surveiller en masse

Les JO 2024, médaille d’or de la surveillance de masse, article du site Reporterre, juillet 2023

Les Jeux olympiques de 2024, qui débuteront le 26 juillet prochain, consacreront des centaines de millions d’euros aux caméras, drones et policiers pour surveiller Paris. Des mesures d’exception qui risquent de perdurer longtemps après la compétition.

Dans les rues, des dizaines de milliers de policiers, de gendarmes, d’agents de sécurité privés. Sur les façades des immeubles, au creux des réverbères, entre les pales de drones, des caméras de vidéosurveillance, captant des images analysées en temps réel par des intelligences artificielles sommées de détecter tout comportement « suspect« .

15 millions de visiteurs sont attendus, les autorités françaises ont vu grand : un budget minimum de 419 millions d’€, dont 50 millions prévus pour le seul déploiement de 900 nouvelles caméras dans la capitale et ses environs.

Sont également annoncés la création — pour 25 millions d’euros — d’un « commissariat du futur« truffé de drones à Élancourt (Yvelines), la construction d’un nouveau centre de vidéosurveillance à Saint-Denis (Seine-Saint-Denis) pouvant constater « jusqu’à 500 infractions par jour »…

Thomas, du collectif Saccage 2024, déplore que « les Jeux olympiques et paralympiques entraînent une militarisation de l’espace public« . Approuvé par l’anthropologue Matheus Viegas Ferrari, qui observe que « les Jeux olympiques et paralympiques sont avant tout un spectacle sécuritaire. Après les guerres, c’est là qu’est dépensé le plus gros budget sécuritaire. »

En 2012, des batteries de missiles avaient été disposées sur des toits d’immeubles durant les Jeux de Londres.

ici lors d’un exercice avant ces Jeux. OGL v1.0 / Richard Watt / Defence Imagery via Wikimedia Commons

Deux dispositions de la loi relative aux Jeux olympiques et paralympiques, parue le 20 mai dernier au Journal officiel, sont particulièrement décriées par les défenseurs des libertés :

- l’article 17 prévoit de punir de 7 500 euros d’amende le fait de se maintenir sur l’aire de compétition d’une enceinte sportive, un mode d’action plébiscité par les activistes écologistes, notamment de Dernière rénovation.

- l’article 10, autorise, jusqu’au 31 décembre 2024, la vidéosurveillance algorithmique des manifestations « sportives, récréatives ou culturelles ».

Ce dernier conduit à confier à une intelligence artificielle l’analyse d’images captées par des caméras fixes ou des drones, et lui permettre d’alerter la police dès qu’elle détecte un comportement estimé anormal — marcher à contre-sens, par exemple, ou rester statique trop longtemps. Selon Katia Roux, d’Amnesty International France, cette technique constitue une atteinte à plusieurs droits fondamentaux : celui à la vie privée « puisque des données comportementales et corporelles vont être analysées par cet algorithme », mais également à la liberté d’expression et à la liberté de réunion pacifique.

« Une telle surveillance peut avoir un effet extrêmement dissuasif sur l’exercice de ces droits, parce que l’on n’agit pas de la même manière quand on se sait ou que l’on se pense surveillé, ça peut nous amener à réfléchir à deux fois avant de rejoindre un rassemblement ou de s’exprimer.«

Cette disposition pose d’autant plus problème, précise-t-elle, que la surveillance automatisée « n’a jamais démontré son efficacité contre la criminalité et le terrorisme, alors que ses conséquences sur les libertés fondamentales, elles, sont avérées« .

« Ces outils sont toujours utilisés contre les mêmes personnes : les militants, les quartiers populaires, les étrangers« , renchérit Noémie Levain, de la Quadrature du Net. « Intrinsèquement, les Jeux olympiques et paralympiques produisent un état d’exception que les responsables de la sécurité et leurs alliés au sein des gouvernements convertissent en une occasion de renforcer leurs stocks d’armes et de passer des lois dont l’horizon temporel s’étend bien après les cérémonies de clôture« , dit l’ancien athlète et universitaire Jules Boykoff, auteur de Power Games : a political History of the Olympics (Verso, 2016, non traduit). « Maintes et maintes fois, les lois créées pour protéger les Jeux sont restées effectives bien après leur fin.«

L’histoire olympique regorge de tels exemples. En Australie, la législation mise en place pour sécuriser les Jeux d’été de Sydney en 2000, a « appauvri les libertés civiles« , selon des chercheurs, en offrant notamment à la police le droit de fouiller ou d’évacuer des individus considérés comme gênants de certains lieux.

Les Jeux de Londres, en 2012, ont contribué à l’extension de la vidéosurveillance dans les rues. La reconnaissance faciale a quant à elle été autorisée en Russie à l’occasion de la coupe du monde de football de 2018. « Trois ans après, elle était utilisée pour identifier des opposants et les arrêter chez eux« , signale Katia Roux.

Citons également la loi « anticonspiration », adoptée à la faveur des Jeux olympiques de Tokyo en 2020, et critiquée jusqu’aux Nations unies en raison des pouvoirs de surveillance étendus qu’elle conférait à l’État.

Autre article : Les Jeux olympiques ouvrent la voie aux technologies sécuritaires, article du site Reporterre, mars 2021

La SNCF teste la reconnaissance faciale

En prévision des JO, la SNCF a testé plus d’une dizaine d’algorithmes de vidéosurveillance, du 25 décembre 2023 sur le site de Médiapart

Depuis 2017, la SNCF a expérimenté plusieurs outils de surveillance des géants français Thales et Atos, les PME françaises Aquilae et XXII mais aussi des sociétés israéliennes Briefcam [le site Disclose a depuis révélé que la police française disposait depuis 2015 de logiciels de cette société et qu’elle s’en servait pour faire de la reconnaissance faciale illégale] et Anyvision. Ces outils, proches de la reconnaissance faciale, pourraient être expérimentés par la SNCF durant les Jeux olympiques.

Déjà, 70 000 caméras sont installées par la SNCF en France : 17 000 dans les gares [2300 dans la seule région Auvergne-Rhône-Alpes, comme s’en vante l’administration Wauquiezienne], et 45 000 embarquées dans les trains [10 000 en AuRA].

La loi « Jeux olympiques » du 19 mai 2023 a fixé un cadre à l’expérimentation de ces logiciels jusque-là illégaux. Jusqu’en mars 2025, lors d’événements sportifs et culturels – dont les JO –, la police, la gendarmerie, mais aussi les services de sécurité de la SNCF peuvent coupler ces IA aux caméras pour identifier la présence d’objets abandonnés, un mouvement de foule ou le port d’une arme.

Lors du passage de la loi Jeux olympiques devant le Parlement, des députés s’alarmaient de voir ces systèmes de vidéosurveillance intelligente « créer un précédent de surveillance jamais vu en Europe« . Mais la SNCF ambitionne depuis plusieurs années « de se positionner comme un acteur majeur et incontournable des technologies liées à la vidéo« , comme elle l’écrit sur son site internet…

Anyvision, non biométrique ?

La SNCF a déjà testé, entre 2017 et 2021, avec l’accord de la Commission nationale de l’informatique et des libertés (CNIL), 19 logiciels de vidéosurveillance algorithmique en conditions réelles sur les citoyen·nes fréquentant ses gares. Elle s’est tournée vers le logiciel de vidéosurveillance algorithmique d’Anyvision, car il n’examine pas, selon elle, une donnée biométrique – le visage d’un individu – mais d’autres caractéristiques non biométriques comme la démarche ou la tenue vestimentaire.

En 2020, la SNCF a passé certains voyageurs à la moulinette d’un logiciel développé par la firme israélienne Anyvision – renommée en 2021 Oosto. Associés aux caméras, ses algorithmes sont capables de suivre en temps réel une personne sur l’ensemble du réseau, selon différentes caractéristiques. « C’était une solution non biométrique de recherche de personnes basée sur les vêtements« , complète un salarié impliqué dans le projet. Ce logiciel pourrait ainsi retrouver une personne ayant abandonné un bagage, l’auteur·e d’un délit ou d’un crime ou tout autre personne volontaire.

Katia Roux, d’Amnesty International, souligne qu' »il y a un vrai débat sur le caractère biométrique ou non de ces technologies de vidéosurveillance algorithmique. Une démarche ou un vêtement est un élément qui permet d’identifier concrètement quelqu’un. C’est donc une donnée biométrique. Or, le Règlement général sur la protection des données [RGPD] interdit le traitement de ces données, sauf exceptions« .

La société Anyvision est connue pour ses liens avec le monde militaire israélien. En 2020, son président est Amir Kain, ancien chef du département de la sécurité au ministère israélien de la défense. Tamir Pardo, l’un de ses conseillers, est un ancien chef du Mossad, l’agence de renseignement israélienne. La même année, Microsoft décide de revendre ses parts dans la société, à la suite de la publication d’une enquête de NBC News qui pointe le rôle de l’entreprise dans un programme de surveillance en Cisjordanie.

Annonce qui n’a pas dissuadé la SNCF de mener une expérimentation avec l’entreprise… En 2017, la SNCF a testé un logiciel d’aide à l’investigation d’une autre firme née en Israël, Briefcam. Il y a quelques semaines, le tribunal administratif de Caen a estimé que le recours à ce logiciel par la communauté de communes de Deauville « portait une atteinte grave et manifestement illégale au respect de la vie privée », selon les termes de la décision.

La même année, la SNCF a également testé une solution de détection « d’anormalités » du géant français Thales. Un logiciel à l’usage flou, dont les algorithmes, couplés à des caméras de videosurveillance, pourraient détecter des citoyens et citoyennes adoptant des « comportements dangereux« dans les gares. Thales refuse d’entrer dans le détail, par souci de confidentialité : « le groupe propose une plateforme digitale de fusion de données hétérogènes pour contribuer à créer des territoires de confiance, des villes plus intelligentes, plus sûres et résilientes.« Pour Noémie Levain, de La Quadrature du Net, « cela signifie que la SNCF délègue la définition d’un comportement anormal d’un citoyen en gare à un algorithme, qui plus est développé par des sociétés pour la plupart issues de l’industrie militaire, dont la définition de la sécurité est nécessairement subjective, politique et repose sur la base d’une vision répressive et discriminante. »

Par le passé, la SNCF avait déjà testé deux autres algorithmes du même type, ceux de la start-up française XXII et de l’entreprise japonaise Fujitsu. Plusieurs gares ont été concernées par au moins une de ces expérimentations, notamment les gares parisiennes du Nord, de l’Est et Saint-Lazare, celles de Marseille-Saint-Charles et de Lyon-Part-Dieu.

CSU de la gare de Lyon-Part-Dieu

Efficacité de ces technologies

« Il y a des questionnements légitimes sur la maturité de ces technologies : est-ce que les policiers ou opérateurs de terrain ont conscience de leur efficacité relative ? Si un policier ne l’est pas et considère que l’IA est infaillible, il peut estimer qu’une zone où il n’y a aucune détection de port d’armes est sécurisée, alors que ce n’est pas forcément le cas, compte tenu des erreurs des logiciels. En l’absence de démarche scientifique d’évaluation de l’impact de ces technologies, il est hasardeux de se positionner sur leur efficacité », détaille le chercheur Guillaume Gormand, auteur d’une enquête sur la vidéosurveillance.

Ainsi, sur 1 939 enquêtes, 22 seulement à avoir été élucidées ont pu bénéficier d’éléments tirés de l’exploitation d’enregistrements de vidéoprotection publique, soit 1,13 % du total. En ne retenant que les enquêtes élucidées, l’étude révèle que 5,87 % ont bénéficié d’une contribution vidéo, soit environ 1 sur 20.

Certes, les résultats varient en fonction des infractions : on recense 7,5 % d’indices trouvés dans des affaires d’atteintes aux véhicules et 5,7 % dans des affaires de violences. Mais, observe M. Gormand dans son rapport, « en fin de compte, la découverte d’éléments probants, peu importe la thématique considérée (…) s’avère faible« . Pour preuve, plus de 18 % des enquêtes solutionnées l’ont été sans le moindre apport de la vidéo. Conclusion : « l’exploitation des enregistrements de vidéoprotection constitue une ressource de preuves et d’indices peu rentable pour les enquêteurs. »

Les gendarmes semblent avoir intégré la pratique visant à évaluer les coûts et les bénéfices du recours aux caméras de vidéosurveillance. Et les inconvénients semblent avoir emporté leur conviction : le visionnage d’images est mobilisé dans une enquête sur dix seulement, avec toutefois de fortes disparités en fonction des relations entretenues avec les gestionnaires du réseau de surveillance.

Les députés Philippe Gosselin et Philippe Latombe, coauteurs de la Mission d’information sur les « enjeux de l’utilisation d’images de sécurité dans le domaine public dans une finalité de lutte contre l’insécurité« , notent l’efficacité fluctuante de certaines technologies : « si le comptage d’un flux de spectateurs ou le repérage d’un individu dans une zone interdite correspondent aujourd’hui à des technologies matures, la détection de personnes au sol, d’objets abandonnés, de mouvements de foule ou du port d’une arme présente une relative complexité, en dépit de l’ampleur des progrès technologiques récemment accomplis. »

Cela n’empêche pas l’autorisation à les analyser par ces systèmes d’IA dans le cadre de la loi Jeux olympiques. Jusqu’en mars 2025, ils peuvent donc être librement testés en temps réel sur les citoyens et citoyennes…

Autres sources

Les JO de Paris 2024 sous enquêtes (différents articles du site Médiapart)

Non au Saccage2024 ! (collectif de sensibilisation, d’organisation et de soutien aux mobilisations anti-JOP)